GEO : comment optimiser sa visibilité dans les IA

Le SEO ne disparaît pas. Mais l’accès à l’information change avec ChatGPT et les moteurs IA. Je vous donne mes clés pour adapter votre stratégie.

Chloé Boucaut

Consultante SEO

SEO

À retenir

- Le SEO ne disparaît pas, il évolue vers des logiques de réponse.

- Les moteurs synthétisent désormais plusieurs sources fiables.

- Un contenu structuré et crédible peut être directement cité.

- Le GEO ajoute une couche stratégique au SEO classique.

- L’objectif devient clair : être une source que les IA choisissent.

Le SEO ne disparaît pas. En revanche, la façon dont les internautes accèdent à l’information est en train de changer.

Aujourd’hui, une recherche peut déboucher sur une page de résultats classique, mais aussi sur une réponse générée par une IA, nourrie par plusieurs sources, reformulée, synthétisée et parfois citée. Google indique d’ailleurs que ses expériences IA peuvent s’appuyer sur plusieurs sous-requêtes pour construire une réponse plus complète.

En tant que consultante SEO, c’est un point que j’intègre dans mes analyses. Pendant longtemps, l’objectif était surtout de faire monter une page dans les SERPs de Google. Désormais, il faut aussi se demander si son contenu est assez clair, assez fiable et assez structuré pour être extrait, cité et réutilisé dans un moteur de réponse.

C’est pour cela que le sujet n’est pas “comment tricher pour les IA”. Le vrai sujet, c’est : comment devenir une source que les moteurs ont naturellement intérêt à reprendre.

GEO : définition et différence avec le SEO

Le SEO et le GEO n'ont pas exactement le même objectif.

Le SEO cherche à faire remonter une page dans les résultats de recherche, dans les SERPs.

Le GEO cherche à faire en sorte qu’une information soit facile à reprendre, à citer et à synthétiser par un moteur de réponse (LLM).

Le SEO cherche à faire ranker une page, le GEO cherche à rendre une information réutilisable

En SEO, nous optimisons une URL : son contenu, son maillage, sa pertinence, son indexation, sa capacité à se positionner.

En GEO, nous allons un cran plus loin. Nous nous demandons aussi :

l’information est-elle claire dès les premières lignes ?

la réponse est-elle structurée ?

le contenu est-il assez fiable pour être repris ?

un moteur peut-il extraire un passage sans le déformer ?

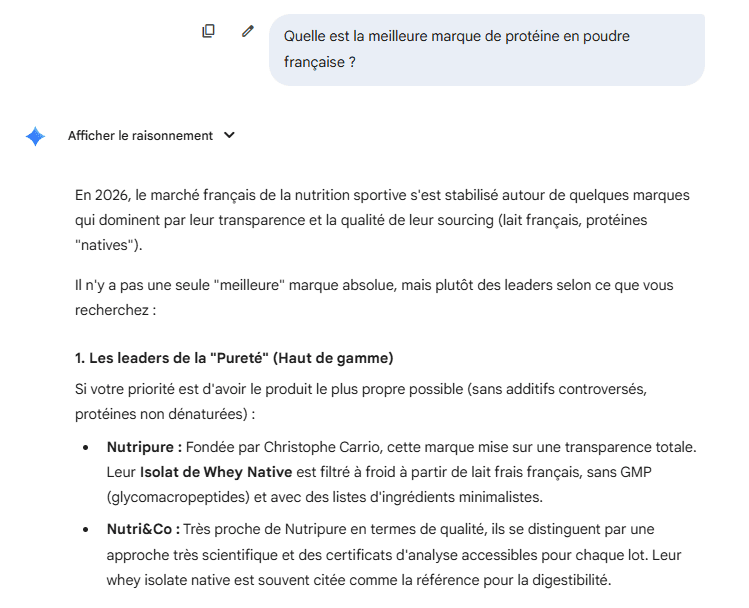

Exemple de réponse générée par l'IA Overview 👆

C’est la différence. Un bon contenu GEO est un contenu qui se prête bien à l’extraction : définitions nettes, étapes lisibles, comparatifs utiles, blocs bien découpés, signaux de crédibilité visibles.

Pourquoi le GEO ne remplace pas le SEO

Il faut être très clair sur ce point : le GEO ne remplace pas le SEO.

Google explique lui-même que pour apparaître dans ses fonctionnalités IA, il faut appliquer les mêmes fondamentaux SEO que pour la recherche classique : respecter les exigences techniques du Search, suivre les règles de Google et publier un contenu utile, fiable et pensé pour les personnes. Google précise aussi qu’il n’y a pas d’exigence technique supplémentaire pour être éligible comme lien de soutien dans AI Overviews ou AI Mode.

Autrement dit :

pas d’indexation propre = pas de visibilité solide

pas de contenu utile = peu de chances d’être repris

pas de structure claire = extraction plus difficile

pas de crédibilité = confiance limitée

Le GEO ajoute donc une couche de lisibilité et de réutilisabilité. Il ne remplace pas le socle.

Ce qui change avec les moteurs de réponse (IA)

Ce qui change, c’est la manière dont le contenu est utilisé.

Avec les IA, nous ne travaillons plus seulement pour obtenir un clic sur un lien. Nous travaillons aussi pour qu’un moteur puisse :

trouver la bonne page

comprendre la bonne partie

extraire le bon passage

l’intégrer dans une réponse plus large

Google indique par exemple que ses expériences IA peuvent utiliser une logique de query fan-out, c’est-à-dire lancer plusieurs recherches liées sur différents sous-sujets pour construire une réponse plus complète.

C’est pour cela qu’il n’existe pas de “balise GEO magique”. Ce qui fonctionne, ce sont surtout des contenus mieux structurés, plus explicites et plus fiables.

Comment une réponse IA est construite ?

Pour bien travailler le GEO, il faut comprendre une chose simple : un moteur de réponse ne “lit” pas le web comme un humain. Il suit généralement une chaîne en plusieurs étapes.

Étape 1 : exploration, crawl, indexation ou récupération via partenaires

Première étape : le moteur doit pouvoir accéder au contenu.

Selon les cas, cela passe par : le crawl, l’indexation ou la récupération via des sources déjà intégrées.

Côté Google, pour être éligible dans ses fonctionnalités IA, une page doit être indexée et éligible à l’affichage d’un snippet dans Google Search.

Si la page n’est pas accessible, proprement servie ou indexable, elle part déjà avec un handicap.

Étape 2 : reformulation de la requête en sous-questions

Ensuite, le moteur ne se contente pas toujours de la requête brute.

Il peut : élargir l’intention, reformuler la demande, découper le sujet en sous-questions.

C’est la logique du query fan-out évoquée par Google : le système peut lancer plusieurs recherches connexes pour construire une réponse plus riche.

Conséquence directe : un contenu GEO performant doit souvent répondre à plusieurs angles d’un même sujet, pas seulement à une requête ultra littérale.

Étape 3 : récupération de documents et sélection de passages

Une fois les bonnes sources identifiées, le moteur ne retient pas forcément la page entière.

Il va souvent chercher :

le meilleur passage

la meilleure définition

le meilleur tableau

la meilleure formulation pour répondre à un point précis.

C’est ici que beaucoup de contenus échouent : ils sont parfois bons sur le fond, mais mal découpés ou trop vagues pour être facilement extraits.

Étape 4 : synthèse, arbitrage et citations

Dernière étape : le moteur produit une synthèse.

Il reformule, combine plusieurs éléments, arbitre entre différentes sources et, selon les interfaces, ajoute des liens ou des citations.

À ce stade, la page la plus utile n’est pas toujours la plus longue.

C’est souvent la plus claire, la plus facile à exploiter et la plus fiable.

Pourquoi la bataille ne se joue pas seulement sur une page ?

C’est l’un des changements les plus importants.

En SEO classique, nous raisonnons souvent à l’échelle de la page.

En GEO, il faut aussi raisonner à l’échelle du passage.

Un article peut être excellent dans l’ensemble, mais contenir peu de blocs vraiment extractibles.

À l’inverse, une page simple mais très bien structurée peut offrir plusieurs passages réutilisables.

C’est pour cela que je recommande presque toujours :

des définitions courtes et nettes

des intertitres explicites

des blocs autonomes

des listes à puces

des comparatifs lisibles

des formulations qui répondent vite à une question

Le GEO, c'est la partie émergée. La mise en œuvre, c'est autre chose.

Crawl, query fan-out, blocs extractibles, signaux de confiance... Comprendre le sujet ne suffit pas, encore faut-il savoir où agir en premier sur votre site.

Pourquoi certains contenus sont repris par les IA… et d’autres non

Deux pages peuvent traiter le même sujet, avec un niveau d’expertise proche, et pourtant une seule sera reprise. Pourquoi ? Parce qu’aujourd’hui, la visibilité ne dépend pas seulement de la qualité du fond. Elle dépend aussi de la capacité du contenu à être compris rapidement, découpé proprement et réutilisé sans ambiguïté.

Un contenu utile, clair et directement exploitable

Le premier filtre reste simple : le contenu apporte-t-il une vraie réponse ?

Google répète que ses systèmes cherchent à mettre en avant des contenus utiles, fiables et pensés d’abord pour les personnes, pas des contenus créés pour manipuler les classements.

Dans les faits, les contenus les plus repris sont souvent ceux qui vont droit au but :

ils répondent vite à la question

ils évitent le flou

ils donnent un angle clair

ils ne noient pas l’information utile dans du remplissage

Une structure qui aide l’extraction : définitions, tableaux, FAQ, étapes

Un moteur de réponse ne “consomme” pas une page comme un lecteur humain.

Il cherche des éléments exploitables :

une définition claire

une liste d’étapes

un comparatif

une FAQ bien formulée

un tableau synthétique

Plus la structure aide à isoler l’information, plus le contenu devient réutilisable.

C’est là qu’une bonne mise en forme peut aider : intertitres explicites, paragraphes courts, listes à puces, blocs autonomes.

Des signaux de confiance visibles : auteur, expertise, preuves, sources

Un contenu peut être lisible sans être crédible.

Pour être repris, il faut aussi envoyer des signaux de confiance. Google invite clairement les créateurs à montrer qui produit le contenu, quelle expertise est mobilisée et pourquoi le lecteur devrait faire confiance à la page.

Cela passe par des éléments simples :

un auteur identifiable

une expertise cohérente avec le sujet

des preuves, exemples ou cas concrets

des sources sérieuses quand c’est utile

un site globalement propre et crédible

Une marque ou un site que les moteurs identifient comme référence

Enfin, il ne faut pas regarder une page isolément.

Les moteurs évaluent aussi le contexte global :

la cohérence éditoriale du site

son niveau de spécialisation

sa réputation

sa capacité à publier régulièrement du contenu utile

Google rappelle d’ailleurs que ses systèmes s’appuient sur les mêmes principes de contenu utile et people-first dans plusieurs environnements de recherche.

Autrement dit, un contenu a plus de chances d’être repris s’il s’inscrit dans un site qui inspire déjà confiance. Ce n’est pas seulement une question de texte. C’est aussi une question de positionnement et de crédibilité générale.

Les 5 piliers d’un contenu GEO-friendly

Quand je retravaille un contenu pour le rendre plus visible dans les moteurs de réponse, je reviens presque toujours aux mêmes fondamentaux : clarté, structure, fiabilité, crédibilité et accessibilité technique.

Pilier 1

Réponse claire dès le début

Le contenu doit annoncer rapidement ce qu’il va apporter.

Une réponse visible dès l’introduction aide le lecteur à se repérer, le moteur à comprendre le sujet et la page à gagner en lisibilité.

Pilier 2

Structure en blocs autonomes

Un bon contenu GEO se lit par blocs.

Chaque section doit presque pouvoir vivre seule : un intertitre explicite, une idée centrale, une réponse claire et une formulation autonome.

Pilier 3

Informations fiables et contextualisées

Plus le sujet est technique ou sensible, plus la précision est importante.

Evitez les formulations vagues, les promesses floues et les affirmations sorties de leur contexte.

Pilier 4

Crédibilité éditoriale

Le contenu doit refléter une vraie expertise.

L’expérience, l’angle et le niveau de maîtrise du sujet font la différence. Le fond doit être cohérent avec la personne ou la marque qui publie.

Pilier 5

Base technique solide

Le fond ne suffit pas si la page est mal servie techniquement.

Crawl, HTML rendu, balisage, structure et signaux de fraîcheur permettent au contenu d’être trouvé, lu et compris correctement.

En pratique : un contenu GEO-friendly est un contenu clair, bien structuré, crédible et techniquement propre, donc plus facile à comprendre, extraire et citer.

GEO technique : les implémentations qui renforcent la visibilité

Dans le GEO, la technique est aussi importante pour qu'un contenu puisse être trouvé, lu et exploité correctement.

Crawl, robots.txt et accès des bots

Première base : le bot doit pouvoir accéder au bon contenu.

Un fichier robots.txt sert à indiquer aux crawlers quelles URLs ils peuvent explorer et celui-ci ne doit pas être utilisé pour la désindexation. Pour empêcher l’indexation, il faut d’autres mécanismes, comme noindex.

Dans un contexte GEO, il faut surtout comprendre qu’il n’existe pas un seul bot, mais plusieurs logiques :

Googlebot pilote l’exploration pour Google Search et ses fonctionnalités associées.

Google-Extended est un token de contrôle distinct. Google précise qu’il sert à gérer l’usage du contenu pour certains usages Gemini, sans impact sur l’inclusion dans Google Search ni sur le ranking.

OAI-SearchBot est utilisé pour faire remonter des sites dans les résultats de recherche de ChatGPT. OpenAI indique qu’il est indépendant de GPTBot.

GPTBot correspond à l’usage lié à l’entraînement des modèles de fondation d’OpenAI.

Bingbot reste le crawler de Bing pour la découverte et l’exploration du web dans l’écosystème Bing.

Applebot explore le contenu public du web pour certains usages Apple liés à Spotlight et Safari.

HTML lisible, SSR, SSG et limites du JavaScript

Un moteur ne doit pas avoir à deviner votre contenu principal.

Si les informations importantes n’apparaissent qu’après un rendu JavaScript tardif, vous ajoutez de la friction.

En pratique, il vaut mieux viser :

un contenu critique visible dans le HTML

une structure propre dès le chargement

une dépendance limitée à des scripts non essentiels.

Données structurées : clarifier les entités et les contenus

Les données structurées ne “créent” pas à elles seules la visibilité.

En revanche, elles aident à clarifier qui parle, de quoi parle la page, et comment le contenu doit être interprété.

Dans ce cadre, les schémas les plus utiles sont souvent :

Organization, Person, LocalBusiness, Article, FAQPage et BreadcrumbList. Google les documente comme des types de structured data pris en charge ou largement utilisés dans ses environnements de recherche.

L’idée est de baliser ce qui renforce la compréhension du contenu et de l’entité.

Fraîcheur : sitemap, lastmod, mise à jour, IndexNow

Un contenu récent, clairement mis à jour, bien déclaré dans un sitemap et cohérent sur ses dates envoie des signaux plus propres. Google recommande de gérer correctement les sitemaps et les mises à jour associées.

Côté Bing, l’écosystème supporte aussi des approches comme IndexNow pour signaler plus rapidement les changements.

Ce point est souvent sous-estimé. Pourtant, un moteur de réponse préfère généralement s’appuyer sur des informations dont la fraîcheur est lisible.

Pages de confiance : contact, à propos, mentions, politique éditoriale

Un bon contenu isolé ne suffit pas toujours. Il doit vivre dans un site qui inspire confiance.

Cela passe par des pages souvent négligées :

contact

à propos

mentions légales

politique éditoriale

et plus largement tout ce qui aide à comprendre qui publie et dans quel cadre.

Google recommande explicitement de rendre visibles les informations sur l’auteur, le site et le processus de création du contenu quand cela aide l’utilisateur à évaluer la confiance.

Vous avez coché combien de piliers sur cinq ?

Si la réponse est "pas tous", c'est exactement là qu'on commence. Audit de lisibilité, restructuration, signaux de confiance : j'interviens sur ce qui bloque réellement votre visibilité dans les moteurs de réponse.

E-E-A-T, source de vérité et crédibilité éditoriale

Les moteurs de réponse doivent résoudre un problème simple : à quelle source faire confiance ?

Quand une IA synthétise plusieurs documents, elle ne peut pas vérifier chaque affirmation manuellement. Elle doit donc s’appuyer sur des signaux de crédibilité.

C’est là que le E-E-A-T prends toute son importance : expérience, expertise, autorité et fiabilité.

Pourquoi les moteurs de réponse ont besoin d’un “canonical source of truth”

Un moteur de réponse ne peut pas citer n’importe quel contenu. Il doit s’appuyer sur des sources qui semblent stables, contrôlées et crédibles.

C’est ce que l’on peut appeler une source de vérité.

Autrement dit, un site qui :

traite régulièrement un sujet

publie des contenus cohérents

montre une expertise identifiable

et maintient ses informations à jour

L’objectif est de devenir un référentiel identifiable sur un sujet.

Faut-il autoriser les bots IA à accéder à son contenu ?

C’est une question que l'on peut se poser.

Avec l’émergence des LLM, certains éditeurs cherchent à bloquer les bots IA pour éviter que leur contenu soit utilisé. D’autres préfèrent les laisser accéder au site pour bénéficier de visibilité.

La réalité est un peu plus nuancée. Tout dépend de l’usage du bot et de votre modèle économique.

Différence entre recherche, citation et entraînement

Tous les bots IA n’ont pas la même fonction.

Certains servent à découvrir et citer du contenu dans des résultats de recherche.

D’autres servent à entraîner les modèles d’intelligence artificielle.

La différence est importante.

Autoriser un bot de recherche peut vous permettre d’être mentionné comme source dans certaines interfaces.

Autoriser un bot d’entraînement signifie que votre contenu peut être utilisé pour améliorer les modèles eux-mêmes.

Ces deux usages n’impliquent pas les mêmes arbitrages.

Ce que permet ou non robots.txt selon les bots

Le fichier robots.txt permet d’indiquer aux crawlers s’ils peuvent explorer certaines parties d’un site.

Il peut être utilisé pour : autoriser certains bots, en bloquer d’autres ou limiter l’accès à certaines sections.

En revanche, il ne garantit pas toujours le contrôle total de l’usage du contenu. Il reste surtout un signal technique de gouvernance destiné aux crawlers respectueux des standards.

Autrement dit, robots.txt sert à exprimer une politique d’accès, mais ne doit pas être vu comme une protection absolue.

Les arbitrages possibles selon votre modèle économique

La décision d’ouvrir ou non certains bots dépend souvent du modèle économique du site.

Un média très dépendant du trafic peut chercher à limiter certains usages.

Un éditeur SaaS ou un consultant peut au contraire y voir une opportunité de visibilité.

Pourquoi bloquer sans stratégie peut être contre-productif

Bloquer tous les bots IA par principe peut sembler prudent.

Mais cela peut aussi réduire votre visibilité dans les IA comme ChatGPT, Gemini, Claude, etc…notamment lorsque des interfaces de recherche utilisent ces systèmes pour découvrir ou citer des contenus.

Dans beaucoup de cas, la vraie question n’est pas : “faut-il bloquer les IA ?”

La vraie question est plutôt : “quels usages de mon contenu suis-je prêt à autoriser ?”

GEO et trafic : ce que vous pouvez vraiment attendre

Le GEO peut améliorer votre visibilité dans les environnements IA. En revanche, il ne garantit pas automatiquement plus de clics.

C'est important d'en prendre conscience, cela évite beaucoup de faux espoirs et permet de piloter sa stratégie avec plus de lucidité.

Plus de visibilité ne veut pas toujours dire plus de clics

Être cité dans une réponse générée, apparaître dans une AI Overview ou être repris comme source peut renforcer votre présence sur un sujet. Mais cela ne se traduit pas toujours par une visite.

Cela change le comportement des internautes : une partie de la réponse est déjà visible directement dans l’interface.

Autrement dit, vous pouvez gagner en présence sans gagner proportionnellement en trafic.

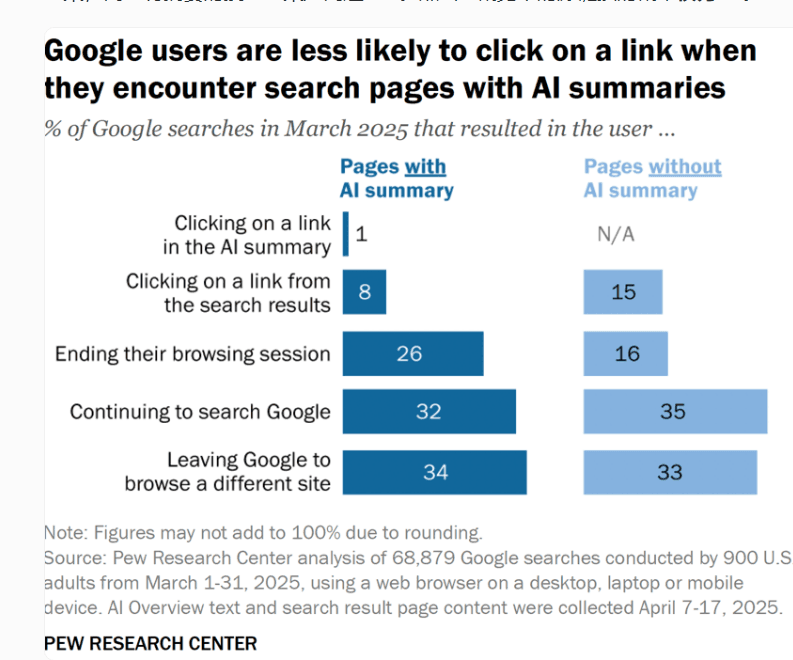

Quand les réponses IA réduisent le trafic

C’est probablement l’évolution la plus importante à comprendre.

Une analyse du Pew Research Center, basée sur des recherches Google observées en mars 2025, montre que les utilisateurs cliquent moins souvent sur des liens quand une synthèse IA est affichée. Les visites avec AI summary ont mené à un clic sur un résultat classique dans 8 % des cas, contre 15 % quand il n’y avait pas de synthèse. Le clic sur un lien cité dans la synthèse est resté très faible, à 1 % des visites.

Un contenu peut être vu, repris, cité… et générer malgré tout moins de clics qu’avant.

Pourquoi la qualité des visites devient encore plus importante

Dans ce contexte, raisonner uniquement en volume de trafic devient moins pertinent.

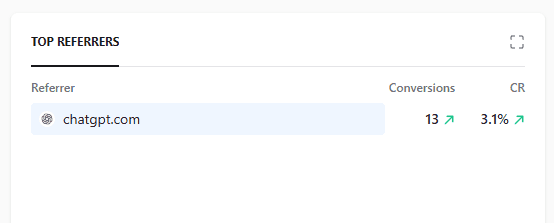

Quand une personne clique malgré tout après avoir vu une réponse IA, son intention est souvent plus mûre. Elle a déjà obtenu une partie de l’information et cherche désormais : une preuve plus solide, un niveau de détail supérieur, un prestataire ou un site de référence.

C’est pour cela que j’accorde de plus en plus d’importance à la qualité des visites : temps passé, pages vues, prise de contact, demande de devis, inscription, achat.

Un trafic un peu plus faible, mais mieux qualifié, peut être plus rentable qu’un trafic plus large et plus superficiel.

Le vrai objectif : capter les bonnes requêtes et les bons moments

Le GEO n’a pas vocation à “récupérer tous les clics”.

Son intérêt est surtout d’augmenter votre présence là où votre expertise est importante. Vu sous cet angle, le GEO devient moins une course au trafic qu’un travail de visibilité utile.

Comment mesurer les résultats de votre stratégie GEO ?

C’est souvent la partie la moins bien traitée. Et pourtant, sans mesure, impossible de savoir si votre visibilité progresse réellement.

Aujourd’hui, le pilotage GEO est encore compliqué. Il faut donc combiner données officielles, observation manuelle et tests.

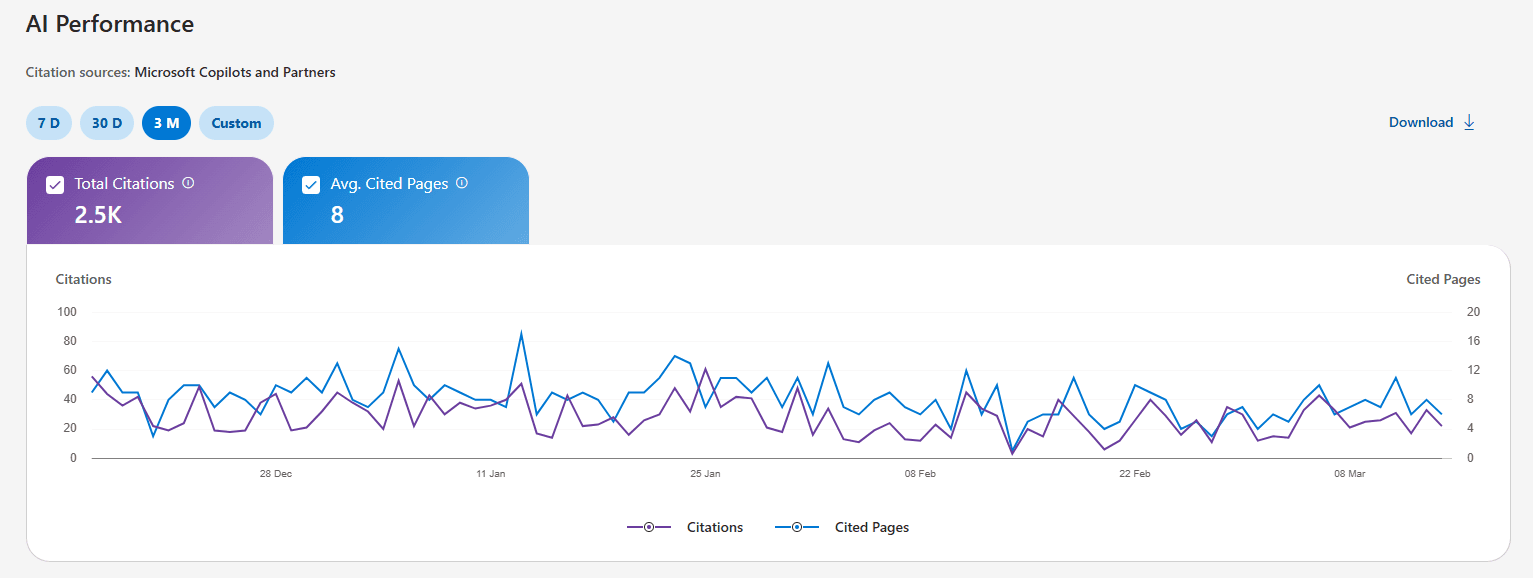

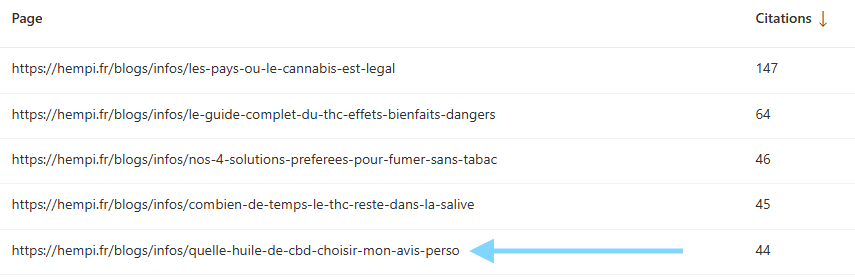

Les rapports IA disponibles côté Bing

Bing a pris de l’avance sur ce point avec AI Performance dans Bing Webmaster Tools, annoncé en préversion publique en février 2026. Le tableau de bord montre notamment les citations totales, les pages citées en moyenne, les grounding queries, l’activité de citation au niveau des URLs et l’évolution dans le temps à travers Copilot, les résumés IA de Bing et certains partenaires.

C’est intéressant parce que cela permet enfin de sortir d’une logique purement SEO et de commencer à suivre la visibilité comme source dans des réponses générées.

Les indicateurs à suivre : citations, trafic qualifié, conversions, mentions

Pour moi, une stratégie GEO sérieuse ne doit pas se limiter à “est-ce que j’ai eu plus de clics ?”.

Je recommande plutôt de suivre quatre familles de signaux :

la citation, pour savoir si votre contenu est repris

le trafic qualifié, pour voir si les visites gagnées sont utiles

les conversions, pour relier la visibilité à un enjeu business ;

et les mentions, pour mesurer votre présence dans l’écosystème du sujet.

C’est cette combinaison qui permet d’avoir une lecture plus juste.

L’intérêt des tests synthétiques et du monitoring manuel

Comme les outils ne communiquent pas encore toutes les données, les tests manuels restent très utiles.

En pratique, cela consiste à interroger régulièrement les moteurs de réponse sur vos sujets cibles, puis à observer : si vous apparaissez, dans quel contexte, sur quel angle, avec quelle page et avec quel niveau de visibilité.

Par exemple : "Quel est le meilleur consultant GEO à Lille ?" ou "Quelle est la meilleure marque de protéine en poudre française ?"

C’est un travail un peu artisanal, mais très utile. Il permet de détecter ce que les dashboards ne montrent pas toujours.

Exemples de tests manuels GEO

Pour vérifier si votre contenu ressort réellement dans les LLM, le plus simple est de tester vos requêtes stratégiques en conditions réelles. L’objectif est de voir où, dans quel contexte et avec quelle page.

Exemple 1

“Quel est le meilleur consultant SEO à Lille ?”

Vérifiez si vous êtes cité, si votre site est mentionné comme source et si la réponse met en avant votre expertise locale ou votre contenu éditorial.

Exemple 2

“Quelle est la meilleure marque de protéine en poudre française ?”

Observez quelles marques sont citées, quels arguments sont repris et si votre contenu apparaît dans un comparatif ou une recommandation.

Exemple 3

“Comment améliorer le SEO d’un site Shopify ?”

Regardez si votre contenu est utilisé comme ressource pédagogique et si les passages les plus structurés de votre page sont ceux qui ressortent.

Conseil pratique : pour réaliser ce type de test, utilisez un mode de navigation privée ou déconnectez-vous de votre session. Cela évite que le moteur de réponse utilise votre historique ou votre profil pour personnaliser les résultats.

Ce qu’il faut noter à chaque test : votre présence ou non dans la réponse, la page citée, l’angle retenu par l’IA et le niveau de visibilité de votre contenu dans la synthèse.

Ma méthode pour rendre un contenu plus visible dans les IA (LLM)

Quand j’optimise un contenu dans une logique GEO, je ne pars d’un principe simple : rendre le contenu plus clair, plus crédible et plus exploitable, à la fois pour un lecteur et pour un moteur de réponse.

Ma méthode s’appuie sur cinq étapes.

1) Audit de lisibilité machine + lisibilité humaine

La première étape consiste à regarder le contenu avec deux grilles de lecture.

La première est humaine : est-ce que le message est clair ? est-ce que la réponse arrive assez vite ? est-ce que la page se lit facilement ?

La seconde est plus machine-oriented : est-ce que le sujet est explicite ? est-ce que les sections sont bien découpées ? est-ce qu’un moteur peut identifier rapidement les bons passages ?

C’est souvent là que les écarts apparaissent. Un contenu peut être correct sur le fond, mais rester trop flou, trop dense ou trop mal structuré pour être repris facilement.

2) Restructuration en blocs extractibles

Ensuite, je retravaille la structure.

L’objectif est de créer des blocs autonomes, avec : un intertitre clair, une réponse nette, une idée par section et une formulation qui reste compréhensible même isolée.

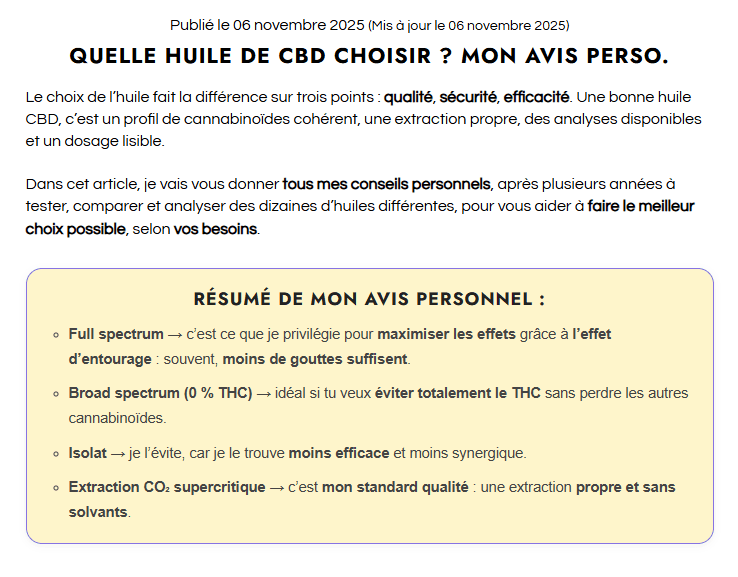

Exemple avec cet article sur l'huile CBD que j'ai rédigé sur Hempi. Il a été cité 44 fois en 30 jours dans l'IA de Bing 👆

3) Renforcement des signaux de confiance

Je regarde aussi tout ce qui renforce la confiance : l’auteur, l’expertise affichée, les preuves, les exemples, la cohérence du ton et la manière dont le site présente son sérieux.

Souvent, ce sont des ajustements assez faciles à faire et ils changent beaucoup la perception générale du contenu.

4) Optimisation technique et entité-first

Je vérifie ensuite le socle technique.

Le contenu principal doit être accessible, lisible dans le HTML, bien balisé et porté par une entité claire. Cette logique “entité-first” est importante : un contenu repris plus facilement est souvent un contenu rattaché à une source bien identifiée.

5) Suivi et ajustements

Enfin, je ne considère jamais le GEO comme un chantier figé.

Je regarde : quelles pages ressortent, sur quelles requêtes, dans quels moteurs, avec quel niveau de visibilité et avec quels effets business.

C’est cette boucle de suivi qui permet d’ajuster la structure, les formulations ou les signaux de confiance quand c’est nécessaire.

Vous savez maintenant comment ça fonctionne.

La question, c'est : avez-vous le temps de le faire ? J'applique cette méthode pour des entreprises, marques et e-commerces qui veulent être cités, pas juste indexés. Stratégie, exécution, suivi : de bout en bout, sans intermédiaire.

FAQ

Le GEO remplace-t-il le SEO ?

Non. Le GEO ne remplace pas le SEO.

Le SEO reste le socle. Sans crawl propre, sans indexation, sans structure claire, sans contenu utile et sans balisage cohérent, il sera difficile d’obtenir une vraie visibilité, y compris dans les environnements IA.

Le GEO ajoute surtout une couche complémentaire : il aide à rendre l’information plus claire, plus extractible et plus crédible pour les moteurs de réponse.

Peut-on optimiser son site pour ChatGPT ?

Oui, mais pas au sens où il existerait une balise ou une technique dédiée à ChatGPT.

En pratique, optimiser son site pour ChatGPT consiste surtout à améliorer la clarté du contenu, la structure des sections, la crédibilité éditoriale et l’accessibilité technique. Un contenu bien organisé, facile à comprendre et porté par une source crédible a naturellement plus de chances d’être repris ou cité.

Faut-il autoriser GPTBot ?

Cela dépend de votre stratégie.

Il faut distinguer deux choses : la recherche et l’entraînement. Autoriser certains bots peut favoriser la découverte ou la citation de vos contenus dans certaines interfaces. En revanche, autoriser d’autres bots peut ouvrir la porte à un usage plus large de vos contenus pour l’entraînement des modèles. La bonne question n’est donc pas seulement “faut-il l’autoriser ?”, mais plutôt : quel usage de mon contenu suis-je prêt à accepter ?

Une FAQ suffit-elle pour faire du GEO ?

Non. Une FAQ peut aider, mais elle ne suffit pas à elle seule.

Elle a un avantage évident : elle produit des blocs courts, explicites et faciles à exploiter. En revanche, une FAQ ne compensera jamais un contenu flou, un site peu crédible ou une structure éditoriale faible. C’est un format utile, pas une stratégie GEO complète.

Comment savoir si mon site est cité par une IA ?

Aujourd’hui, il faut croiser plusieurs méthodes.

Les outils classiques donnent une partie de la réponse, mais pas toute. Il est donc utile d’observer les requêtes stratégiques manuellement, de suivre les pages qui ressortent le plus souvent et de regarder si certaines visites ou conversions semblent liées à cette nouvelle visibilité. Le pilotage GEO repose encore beaucoup sur une combinaison entre données, observation et tests réguliers.

Le GEO génère-t-il vraiment plus de trafic ?

Pas toujours.

Le GEO peut renforcer votre visibilité, votre présence comme source et parfois votre crédibilité perçue. En revanche, cela ne se traduit pas mécaniquement par plus de clics. Une partie des utilisateurs obtient déjà une réponse directement dans l’interface. Il faut donc accepter qu’une meilleure présence dans les moteurs de réponse puisse parfois produire moins de trafic brut, mais un trafic plus qualifié.

Quel type de contenu a le plus de chances d’être repris ?

Les contenus qui ont le plus de chances d’être repris sont généralement les plus clairs, les plus bien structurés et les plus fiables.

Les formats qui fonctionnent bien sont ceux qui rendent l’information immédiatement exploitable : une définition nette, une réponse directe, un comparatif lisible, une explication étape par étape ou une synthèse bien formulée. Plus un contenu est facile à comprendre et à isoler, plus il devient réutilisable.

Faut-il créer des pages spécifiques pour les moteurs de réponse ?

Dans la majorité des cas, non.

Il vaut mieux créer de très bonnes pages pour de vraies intentions de recherche, puis les structurer intelligemment, plutôt que produire des pages artificielles pensées uniquement pour les IA. La meilleure approche reste la même : publier des contenus utiles, précis, bien organisés et portés par une source crédible. Ce sont ces contenus-là qui ont le plus de chances d’être repris naturellement.